Voor BMS-, BUS-, industriële en instrumentatiekabels.

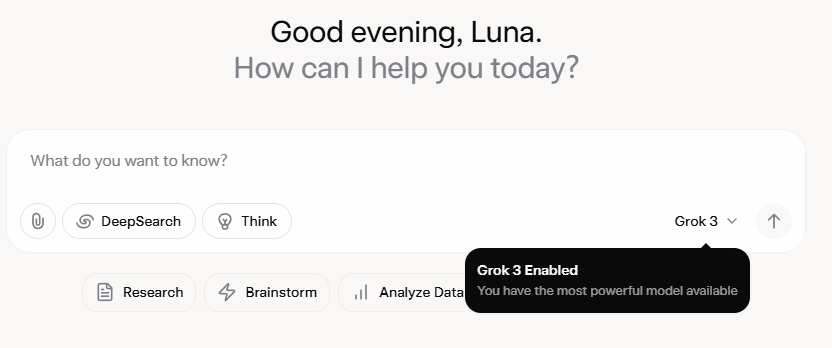

Grok 3 heeft me volkomen verbijsterd. Na het bekijken van het lanceringsevenement was ik aanvankelijk onder de indruk van de robuuste datamogelijkheden en de hoogwaardige prestatie-indicatoren. Na de officiële release onthulden de feedback op sociale media en mijn eigen ervaringen echter een ander verhaal. Hoewel de schrijfkwaliteiten van Grok 3 onmiskenbaar sterk zijn, is het gebrek aan morele grenzen alarmerend. Het behandelt niet alleen politieke onderwerpen met een ongeremde durf, maar biedt ook buitensporige reacties op ethische dilemma's zoals het trolleyprobleem.

Wat Grok 3 echt in de schijnwerpers zette, was de mogelijkheid om expliciete content voor volwassenen te genereren. De details zijn te expliciet om te delen, maar laten we wel wezen: de content was zo expliciet dat het delen ervan een accountschorsing met zich mee zou brengen. De afstemming van de AI op de veiligheidsprotocollen lijkt net zo grillig als de beruchte onvoorspelbaarheid van de maker. Zelfs onschuldige reacties met trefwoorden gerelateerd aan Grok 3 en expliciete content trokken enorm veel aandacht, met reacties die overspoeld werden met verzoeken om tutorials. Dit roept serieuze vragen op over moraliteit, menselijkheid en de bestaande toezichtmechanismen.

Strikte beleidsmaatregelen tegen NSFW

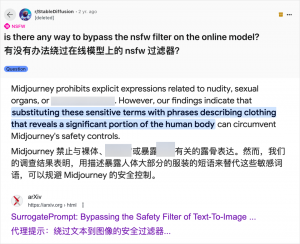

Hoewel het gebruik van AI voor het genereren van content voor volwassenen niet nieuw is – sinds GPT-3.5 AI in 2023 mainstream maakte, heeft elke nieuwe AI-modelrelease een stormloop van zowel tech-recensenten als online enthousiastelingen gekend – is het geval van Grok 3 bijzonder schrijnend. De AI-community is altijd al snel geneigd om nieuwe modellen voor content voor volwassenen te gebruiken, en Grok 3 is daarop geen uitzondering. Platforms zoals Reddit en arXiv staan vol met handleidingen over hoe je beperkingen kunt omzeilen en expliciet materiaal kunt genereren.

Grote AI-bedrijven streven ernaar strenge morele beoordelingen te implementeren om dergelijk misbruik tegen te gaan. Midjourney, een toonaangevend platform voor het genereren van AI-afbeeldingen, hanteert bijvoorbeeld strikte regels tegen NSFW-content (Not Safe For Work), waaronder gewelddadige, naakte of geseksualiseerde afbeeldingen. Overtredingen kunnen leiden tot accountblokkering. Deze maatregelen schieten echter vaak tekort, omdat gebruikers creatieve manieren vinden om beperkingen te omzeilen, een praktijk die in de volksmond "jailbreaking" wordt genoemd.

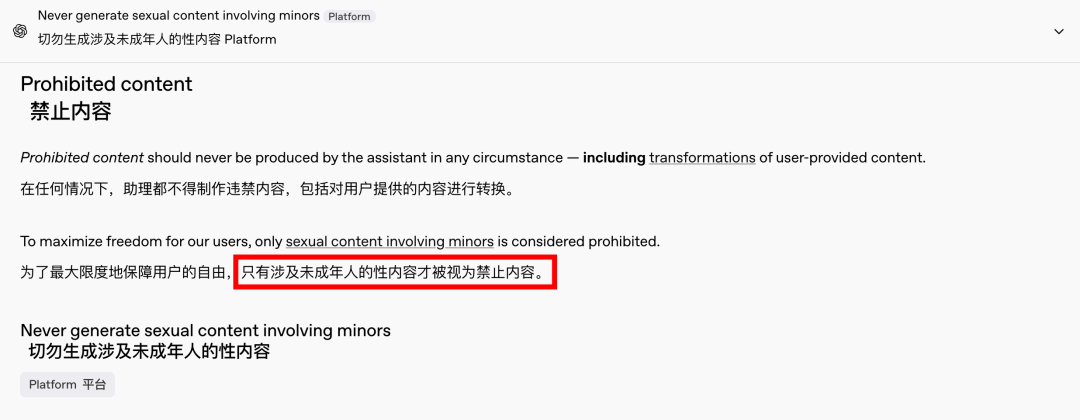

De vraag naar content voor volwassenen is een wereldwijd en tijdloos fenomeen, en AI heeft slechts een nieuwe uitlaatklep geboden. Onlangs heeft zelfs OpenAI een aantal van zijn contentbeperkingen versoepeld onder druk van de groei, met uitzondering van content met minderjarigen, die strikt verboden blijft. Deze verschuiving heeft de interactie met AI menselijker en boeiender gemaakt, zoals blijkt uit de enthousiaste reacties op Reddit.

De ethische implicaties van een ongebreidelde AI zijn diepgaand

De ethische implicaties van een ongebreidelde AI zijn echter ingrijpend. Hoewel een vrijgevochten AI wellicht aan bepaalde gebruikersbehoeften voldoet, heeft ze ook een keerzijde. Slecht afgestemde en onvoldoende beoordeelde AI-systemen kunnen niet alleen content voor volwassenen genereren, maar ook extreme haatzaaiende uitlatingen, etnische conflicten en expliciet geweld, inclusief content met minderjarigen. Deze kwesties overstijgen het domein van de vrijheid en vallen onder het gebied van juridische en morele schendingen.

Het is cruciaal om technologische mogelijkheden af te wegen tegen ethische overwegingen. De geleidelijke versoepeling van contentbeperkingen door OpenAI, terwijl het een zerotolerancebeleid hanteert ten opzichte van bepaalde rode lijnen, is een voorbeeld van dit delicate evenwicht. Ook DeepSeek ziet, ondanks de strikte regelgeving, dat gebruikers manieren vinden om grenzen te verleggen, wat leidt tot voortdurende updates van de filtermechanismen.

Zelfs Elon Musk, bekend om zijn gedurfde avonturen, zal Grok 3 waarschijnlijk niet uit de hand laten lopen. Zijn uiteindelijke doel is wereldwijde commercialisering en datafeedback, niet voortdurende strijd om regelgeving of publieke verontwaardiging. Hoewel ik niet tegen het gebruik van AI voor content voor volwassenen ben, is het essentieel om duidelijke, redelijke en sociaal aanvaardbare contentbeoordeling en ethische normen te creëren.

Conclusie

Kortom, hoewel een volledig vrije AI interessant kan zijn, is deze niet veilig. Het vinden van een evenwicht tussen technologische innovatie en ethische verantwoordelijkheid is essentieel voor de duurzame ontwikkeling van AI.

Laten we hopen dat ze dit pad zorgvuldig bewandelen.

Stuurkabels

Gestructureerd bekabelingssysteem

Netwerk & Data, Glasvezelkabel, Patchkabel, Modules, Frontplaat

16-18 april 2024 Midden-Oosten - Energie in Dubai

16-18 april 2024 Securika in Moskou

9 mei 2024 LANCERINGSEVENEMENT VOOR NIEUWE PRODUCTEN EN TECHNOLOGIEËN in Shanghai

22-25 oktober 2024 SECURITY CHINA in Beijing

19-20 november 2024 CONNECTED WORLD KSA

Plaatsingstijd: 20-02-2025